一覧に戻る

ChatGPTのセキュリティ・情報漏洩リスクは?安全に利用する5つの対策を紹介

近年、AI技術の発展が著しい中、OpenAI社開発のAIチャットボット「ChatGPT」が大きな話題を呼んでいます。ChatGPTをうまく活用することで業務効率化や生産性向上が期待できるため、自社の業務に取り入れられないかと考える企業も多いことでしょう。

しかしながら、ChatGPTには、セキュリティ面での懸念や情報漏洩リスクが指摘される声もあります。AI技術の利便性と引き換えに、企業の機密情報が流出したり、不適切な発言をAIが生成したりするなどのリスクが存在するためです。

そこで本記事では、ChatGPTを企業で安心して活用するための対策について、詳しく解説していきます。企業におけるAI活用の現状と課題、セキュリティリスクと具体的な対策方法、情報漏洩防止策など、ChatGPTを企業で導入する際の注意点を網羅的にお伝えします。

ChatGPTとは?

ChatGPTは、OpenAI社が開発した大規模言語モデルGPTを利用した対話型AIチャットボットです。

画面上で質問や依頼をすると、自然な会話形式で気の利いた回答や情報を提供してくれるのが特徴です。

無料プラン・有料プランの両方があり、無料プランでも最新モデルのGPT-4oを利用することができます。(2024年9月現在)また、APIも公開されているため、スプレッドシート上でChatGPTを回答させたり、自社が開発しているアプリやサービスに組み込んだりといった形式で活用をしていくことも可能です。

ChatGPTの使い方やプランについてもっと詳しく知りたい方は、以下記事をご覧ください。

・ChatGPT最新モデルGPT-4oの使い方を徹底解説!基礎知識から実践的な活用法・コツ・事例も紹介

・ChatGPTの有料版と無料版の違いは?GPT4o後の有料版切り替えメリットについても解説!

ChatGPTに潜むセキュリティリスク・情報漏洩リスク

便利に活用出来るChatGPTには、以下のような情報漏洩リスク・セキュリティリスクが潜んでいます。

いずれも正しく対策すればリスクを回避することができるので、まずは実際の事例とともに詳しく学んでいきましょう。

機密情報や個人情報の流出・漏洩

ChatGPTに企業の機密情報や個人情報を入力すると、その情報がデータベースに記録されます。前の章でお伝えした通り、ChatGPTに入力された情報は基本的には暗号化されて保存され、外部の第三者に意図的に提供されるといったことは原則ありません。

一方で、ChatGPTを初期設定のままにしている場合、入力データがAIモデルの学習に利用され、AIが学習したデータを別のユーザーの回答に利用することによって、意図せず情報漏洩につながる可能性が考えられます。

実際の例として、Samsung社が社内でChatGPTの使用を許可したところ、機密性の高い社内情報を入力してしまった社員がおり、機密情報の流出事案が少なくとも3件発生したと報告されています。

※参照 https://pc.watch.impress.co.jp/docs/news/yajiuma/1490904.html

誤情報や著作権違反になる可能性

ChatGPTが生成したテキストには、著作権侵害や誤情報拡散のリスクがある点にも注意する必要があります。

著作権においては、ChatGPTは著作権侵害を正確に判断できず、意図せずに問題のある情報を出力することがあるためです。

実際、これらの理由から、各国ではAI規制法案が進んでいます。日本では文化審議会著作権分科会法制度小委員会(第7回)にて、AIと著作権の関係が説明されました。著作権の対象となるものや定義などを説明したうえで、AI開発・学習段階を例に生成・利用段階で基本的な考え方を明確にしています。

また、ChatGPTにはハルシネーション(幻覚)という問題があり、AIが創作した内容を事実情報かのように回答してしまうことがあります。そのため、ChatGPTの回答を元に情報発信をする場合、特に専門的な分野の情報は、その分野の専門家に確認を取り、内容が正確かを確かめることが大切です。

サイバー攻撃に悪用される危険性

ChatGPTは高度な文章生成能力を持つ一方で、サイバー攻撃に悪用されるリスクもあります。

たとえば、フィッシングメールや不正なコードの生成など、本来の意図とは異なる使い方をされるケースです。

OpenAIでは悪質なプロンプトへの対応策を講じていますが、巧妙な指示によって制限を回避される可能性もゼロではありません。

また、ChatGPTと連携する外部ツールが攻撃対象となることで、間接的に機密情報が漏洩するリスクもあるため、利用時には十分なセキュリティ対策が必要です。

ChatGPTで実施されているセキュリティ・情報漏洩対策

ChatGPTを運営するOpenAI社は、様々なセキュリティ対策を実施しており、Trust Portalで詳細が公開されています。

以下、重要なポイントについていくつか紹介をします。

データは暗号化(AES-256)した上で保存される

データ転送の通信はTLS1.2で暗号化し、傍受されるリスクを最小化している

災害時に備えてバックアップ体制を構築している

顧客データへのアクセスはOpenAI社内でも必要最低限の人員のみに制限している

また、OpenAI社では、こうした取り組みの証明として、以下のセキュリティ認証を取得しています。

認証 | 詳細 |

CCPA | カリフォルニア州の住民に対するプライバシー保護を定めた州法 |

CSA STAR | CSAが提供するクラウドセキュリティの認証制度 |

GDPR | EU域内の各国に適用される個人データ保護やその取り扱い方法 |

SOC 2 | 米国公認会計士協会が開発したサイバーセキュリティ・コンプライアンス・フレームワーク |

SOC 3 | 米国公認会計士協会のトラストサービスに従い、監査人が受託会社の内部統制を評価&意見を証明した報告書 |

このように運営会社によってセキュリティ対策がなされているChatGPTですが、使い方や設定によっては、意図せず情報漏洩をしてしまったり、セキュリティリスクを高めてしまう可能性があります。

ChatGPT利用時のセキュリティ・情報漏洩対策

では、企業が安全にChatGPTを活用するにはどうすればよいのでしょうか。考えられる対策として以下の5つが挙げられます。

それぞれについて解説していきます。

従業員のリテラシーを向上させる

ChatGPTを安全に活用するためには、従業員一人ひとりのリテラシー向上が欠かせません。

生成AIの仕組みやリスクを正しく理解していないと、意図せず機密情報を入力したり、不適切な使い方をして情報漏洩を招いたりする恐れがあります。

そのため、社内研修やマニュアル整備を通じて、事例を交えた教育を継続的に行うことが重要です。

正しい知識を持つことで、従業員が自律的に安全な使い方を判断できるようになり、組織全体のセキュリティレベル向上にもつながります。

社内共通のルールを作る

ChatGPTを業務で利用する際、社内で統一されたルールを設けることが重要です。セキュリティポリシーを策定し、従業員向けのガイドラインとして公開しましょう。

ガイドラインには具体的には以下のような内容を含めるようにしましょう。

ChatGPTの使用目的

入力可能な内容

生成された文書の管理方法

これらを明文化し社内の正式なルールとして設定することで、不正行為を抑制しセキュリティリスクを軽減できます。

特に、特定の個人情報、未公開の情報やコンテンツ、組織の戦略や内部事情に関するデータなどは、ChatGPTへの入力を控えるべきでしょう。

他にも、どういったデータを入力すべきでないかについて、社内で入力禁止のデータについて明確に定め、周知徹底することが重要です。

また、業務上の利用が必須でなければ、業務中のChatGPT利用を全面的に禁止するという選択肢を検討すべきケースもあるでしょう。

チャット履歴の学習機能をオフにする

チャット履歴の学習機能をオフにし、ChatGPTのサーバーに入力内容が残らないようにするのも有効です。

機密情報をChatGPTに入力すると、サーバーに履歴が残ってしまい、他のユーザーへの回答に自社の機密が表示されるリスクがあるからです。

学習履歴をオフにするには、以下の手順で行います。

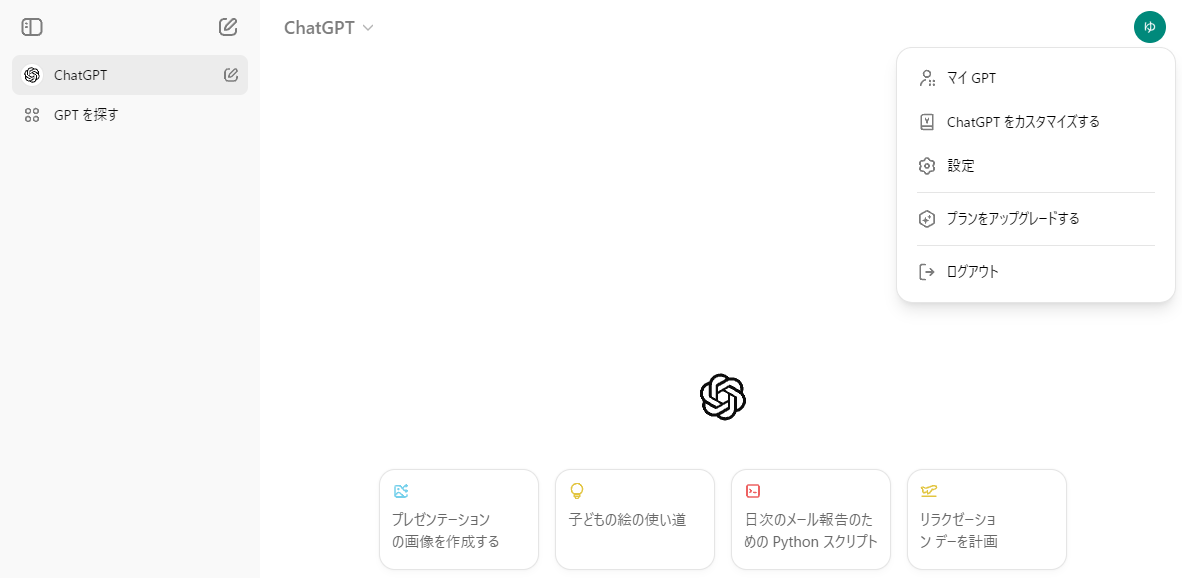

1.アイコンをクリック

2.「設定」→「データコントロール」をクリック

3.「すべての人のためにモデルを改善する」をクリックして、以下画像のようにトグルボタンをオフにし、「実行する」をクリック

4.以下画像のように「オフ」になっていれば完了

この手順で入力内容が記録されなくなり、流出のリスクを下げることが可能です。

履歴をオフにすると、過去にした質問内容が記録されず使い勝手が悪くなるというデメリットも存在します。

しかし、情報漏洩のリスクがあることを考えれば、機密情報を扱う企業の場合は学習機能をオフにしたほうがよさそうです。

生成された内容をそのまま利用しない

ChatGPTが生成する文章やコードには、事実誤認やセキュリティ上の問題が含まれている可能性があります。

そのため、出力された内容をそのまま利用するのは危険です。

特に業務文書やWebコンテンツ、プログラムコードなどでは、必ず事実確認や内容の検証を行いましょう。

ファクトチェックやレビューを怠ると、誤情報の拡散や不具合の発生につながり、企業の信用を損なうリスクもあります。

生成物はあくまでたたき台として活用し、最終的な判断と修正は人間が行うことが大切です。

Teamプラン・Enterpriseプラン・APIを利用する

エンタープライズ向けのプライバシー説明(https://openai.com/enterprise-privacy)にて、Teamプラン・Enterproseプラン・API経由で利用されたデータについては、AIの再学習の対象としないことが明記されています。

これは、機密情報を含んだデータをChatGPTに投入した場合も、情報漏洩リスクがないことを意味します。

なお、Security Portalに記載のように、通常のChatGPT APIの場合、OpenAI社により30日間のデータ保管が発生します。社内規定により日本国外サーバーでのデータ保管が難しい場合、Microsoft社のAzure OpenAIのAPI利用を検討しましょう。

ChatGPTに対する他国の状況

ChatGPTは世界的に大きな注目を集めており、多くの国で利用が広がっています。しかし、個人情報の観点からAIのリスクについて各国で議論が交わされています。

ここでは、アメリカ、中国、イタリア、EU諸国を取り上げ、それぞれの国や地域でのChatGPTへの向き合い方を見ていきたいと思います。

アメリカ

アメリカはChatGPTの開発をしたOpenAI社の拠点です。ニューヨーク市の公立学校では、カンニングへの懸念から2023年1月にChatGPTの利用が禁止されました。しかし、現在はAIを学校システムに活用しようと、現在この禁止は撤廃されています。

また、米カルフォルニアでは2024年8月にAI規制法案が議会通過しており、実現すれば米国初のAI規制法案可決となります。

しかし、大手テック企業や学術界など多方面からAI開発の妨げになるとの反対意見があり、可決されればAI開発に大きな影響が及ぶでしょう。

※参照 https://forbesjapan.com/articles/detail/63290

※参照 https://www.jetro.go.jp/biznews/2024/08/551e8d3acc28c84e.html

中国

中国政府は2023年2月下旬、国内の企業にChatGPTの使用を控えるよう呼びかけました。一方で生成AIの持つ可能性については理解を示しています。

実際、ロイター通信が世界の業者の意思決定者1,600人を対象に行った調査では、中国では回答者の83%が生成AIを採用していると答え、20近くの国・地域の中で最も高い結果が出ています。

知的所有権に関連する国連機関による報告書では、生成AIの特許を中国は2014年から23年の間に3万8000件以上申請し、同時期の米国よりも6,276件もう回っていることが明らかになりました。

中国の裁判所では生成AIが権利侵害、著作権侵害にあたると判決が続いていますが、国際的な標準が定まっていないのが現状です。

※参照 https://jp.reuters.com/markets/global-markets/E44D6EBWNBNG7NBHD7N5BTVHUA-2024-07-09/

※参照 https://www.nikkei.com/article/DGXZQOTG2182F0R20C24A5000000/7

イタリア

イタリアでは2023年3月31日に、以下の理由からChatGPTが一時禁止されました。

個人情報漏洩

青少年への悪影響

雇用へのマイナス影響

現在は他の国と同じように利用可能になっています。

また、2024年3月13日にはAIの開発や利用をめぐり、世界初の包括規制の最終案が可決されました。生成AIの提供企業にAI製であることを明示させ、透明性の担保が目的です。違反した企業には、制裁金が課されます。

さらに生成AIを用いた犯罪には従来よりも厳しい罰を科すとのことで、今後もAIに関する法制定は続くでしょう。

※参照 https://www.nikkei.com/article/DGXZQOGR13D4H0T10C24A3000000/

※参照 https://news.mynavi.jp/techplus/article/20230501-2669831/

EU諸国

欧州議会は2024年5月21日、人工知能(AI)の利用に関する規則案「AI法」を可決したことを発表しました。この法案では、以下のような内容が盛り込まれています。

顔認識ソフトウェアの利用を制限

生成AIの提供企業にデータの開示を求める

ChatGPTのようなAIによるコンテンツ生成では、その旨を明示するよう義務付け

AI規制に関する議論が各国で進む中で、EU諸国が一足先にAI法案を成立させた背景には、AI規制の世界標準にしたい背景があります。

一方で、AI開発の開発が進むように支援を強化する姿勢も見せています

※参照 https://prebell.so-net.ne.jp/news/pre_23062503.html

※参照 https://www.jetro.go.jp/biznews/2024/05/4a706cd3034c4706.html

まとめ

ChatGPTは利便性の高いAIチャットボットですが、セキュリティ面でのリスクも存在します。企業がChatGPTを安全に活用するためには、社内ルールの策定、機密情報の入力制限などの対策が不可欠です。

こうした対策を着実に実施することで、ChatGPTを安全かつ効果的に業務に活用できるでしょう。

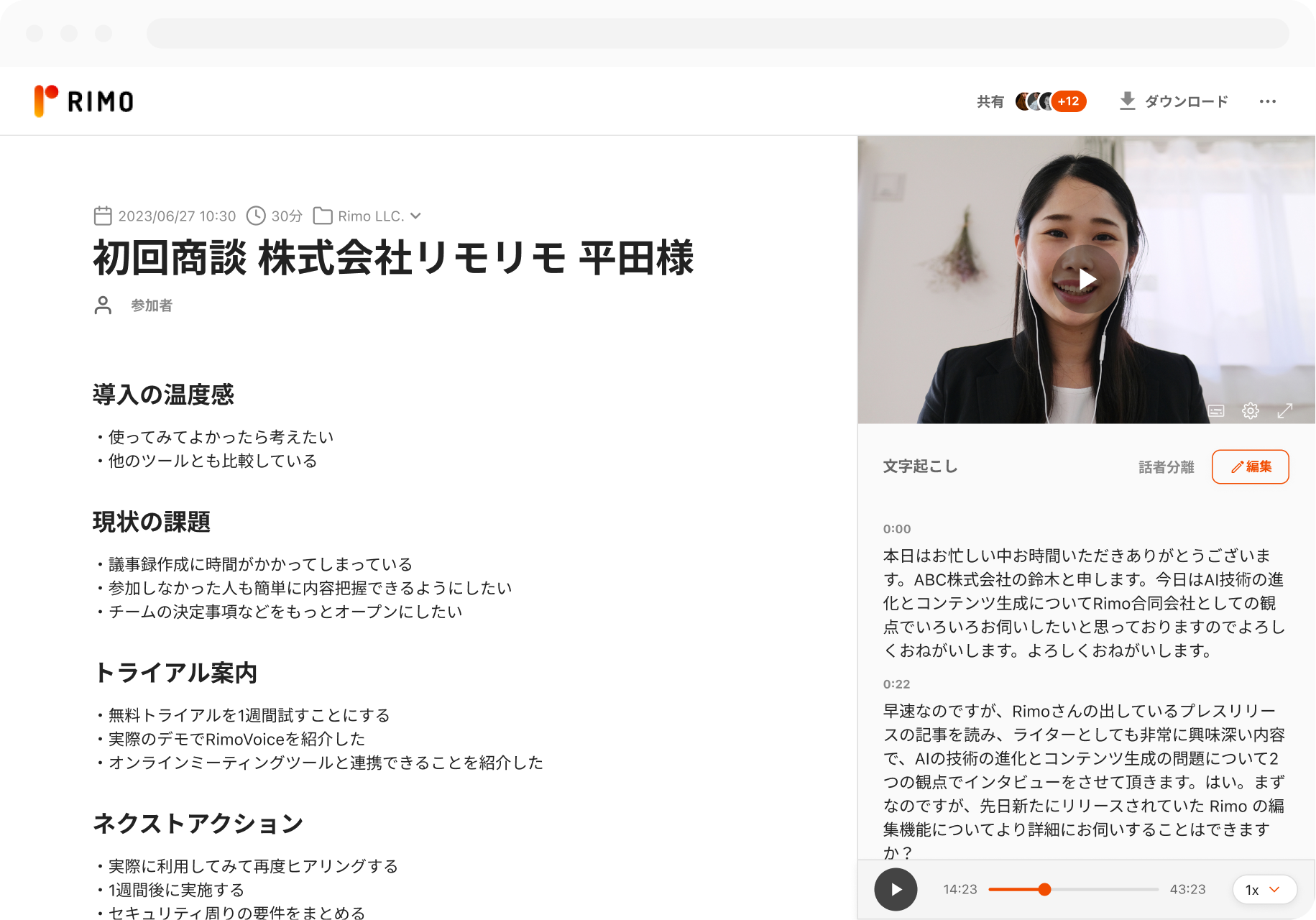

『Rimo Voice』のAIはセキュリティ対策が万全

AI議事録サービス『Rimo Voice』は、動画・音声ファイルをアップロードするだけで文字起こし・議事録作成ができるツールです。会議や取材の音声データをアップロードすると、要点がまとめられた分かりやすい文章を自動的に作成できます。

情報漏洩を防ぐため、『Rimo Voice』は徹底したセキュリティ対策を施しています。『Rimo Voice』では、ChatGPTを含む各種AIモデルをAPIを通じて利用しているため、ユーザーのデータがAIの学習に使われることはありません。

また、国外サーバーでのデータ保管が難しい企業様に向けて、Azure OpenAIのオプションもご用意しております。

このように、『Rimo Voice』は利便性とセキュリティを両立した、安心して使えるサービスです。機密情報を扱う企業様や個人情報を大切にする個人ユーザー様など、

セキュリティ対策が万全なAIツールをお探しな方は、ぜひ『Rimo Voice』をご検討ください。

関連記事

タグ

- AI

一覧に戻る